Trong làn sóng công nghệ 2026, xu hướng đưa dữ liệu về xử lý nội bộ (On-premise) đang trở thành ưu tiên hàng đầu của các doanh nghiệp và lập trình viên. Sự xuất hiện của các mô hình ngôn ngữ mở hiệu năng cao như DeepSeek-R1 (bản Distill), Llama 3 hay Qwen 2.5 cho phép chúng ta vận hành trí tuệ nhân tạo ngay trên máy chủ cục bộ, loại bỏ hoàn toàn nỗi lo rò rỉ dữ liệu nhạy cảm lên đám mây công cộng.

Tuy nhiên, có một ngộ nhận nguy hiểm rằng “chạy Local” đồng nghĩa với việc hệ thống hoàn toàn “Offline” (Air-gapped) và miễn nhiễm với rủi ro mạng. Thực tế, để một hệ thống AI thực sự hữu dụng – biết cập nhật kiến thức mới (RAG), biết tự động tải các bản vá model mới nhất – cánh cửa kết nối Internet vẫn bắt buộc phải mở.

Chính tại giao điểm này, bảo mật AI Local trở thành bài toán sống còn. Proxy không chỉ đơn thuần là công cụ ẩn danh, mà là thành phần hạ tầng bắt buộc (Mandatory Infrastructure) để đảm bảo tính ổn định của luồng dữ liệu và bảo vệ định danh doanh nghiệp. Bài viết này sẽ phân tích sâu kiến trúc mạng và hướng dẫn thiết lập hàng rào bảo vệ chuẩn DevOps cho hệ thống AI của bạn.

Tóm tắt nhanh cho Developer:

- Vấn đề: Chạy AI Local không có nghĩa là Offline. Cần Internet để tải Model và Web Search (RAG).

- Rủi ro: Lộ IP thực, bị Google chặn khi cào dữ liệu, rò rỉ thông tin qua Telemetry.

- Giải pháp: Sử dụng Hybrid Proxy. Dùng Datacenter Proxy cho Ollama (tải nhanh) và Residential Proxy cho Agent (tránh bị chặn).

- Lệnh quan trọng: Luôn cấu hình

NO_PROXY=localhost để tránh lỗi vòng lặp.

Sự thật về phần cứng và kiến trúc Local LLM

Trước khi đi vào giải pháp bảo mật, chúng ta cần hiểu rõ đối tượng mà mình đang vận hành. Việc hiểu sai về quy mô mô hình sẽ dẫn đến những quyết định sai lầm về hạ tầng mạng.

DeepSeek-V3 và thực tế triển khai

Dựa trên báo cáo kỹ thuật chính thức, mô hình gốc DeepSeek-V3 sở hữu tới 671 tỷ tham số (671B). Để vận hành mô hình này ở độ chính xác cao (FP8 hoặc BF16), bạn cần một cụm máy chủ với dung lượng VRAM khổng lồ (lên tới hơn 400GB), điều bất khả thi với các máy trạm cá nhân hay server văn phòng thông thường.

Do đó, khái niệm “Local LLM” trong bài viết này tập trung vào các phiên bản Distilled (Tinh chỉnh) hoặc Quantized (Nén). Ví dụ:

- DeepSeek-R1-Distill-Llama (8B/70B): Chạy mượt mà trên MacBook Pro (M-series) hoặc PC có GPU NVIDIA RTX 3090/4090.

- Qwen 2.5 Coder: Tối ưu cho lập trình viên chạy cục bộ.

Dù chạy bản nhỏ hơn, nhưng nhu cầu mạng của chúng vẫn rất lớn: tải file weights từ 5GB đến 100GB, và thực hiện hàng ngàn truy vấn web mỗi ngày nếu dùng Agent.

Phân định Inference Engine và Client Application

Để bảo mật chính xác, bạn cần tách biệt hai thành phần phần mềm trong hệ thống AI:

- Inference Engine (Bộ máy suy luận):

- Là phần mềm chịu trách nhiệm chạy model, ví dụ: Ollama, vLLM, LM Studio.

- Nhiệm vụ mạng: Kết nối Internet chủ yếu để tải Model Weights (từ Hugging Face/Registry) và gửi dữ liệu đo kiểm (Telemetry).

- Đặc điểm: Thường chạy dưới dạng System Service (Linux) hoặc Background Process.

- Client Application (Ứng dụng khách):

- Là giao diện tương tác hoặc logic nghiệp vụ, ví dụ: OpenWebUI, LangChain Scripts, AnythingLLM.

- Nhiệm vụ mạng: Đây mới là nơi thực hiện các truy vấn tìm kiếm (Web Search/RAG) gửi đến Google/Bing để lấy thông tin thời gian thực.

Nguyên tắc cốt lõi: Cấu hình Proxy cho Ollama chỉ bảo vệ quá trình tải model. Để bảo vệ quá trình tìm kiếm (Search), bạn bắt buộc phải cấu hình Proxy riêng cho Client Application.

Những lỗ hổng hạ tầng khi thiếu Proxy

Việc kết nối trực tiếp hệ thống AI với Internet bằng IP thực của văn phòng hoặc gia đình tạo ra các rủi ro định danh và vận hành nghiêm trọng.

Rò rỉ thông tin qua Telemetry (Viễn trắc)

Mặc định, các nền tảng như Ollama được thiết lập để gửi báo cáo ẩn danh về máy chủ nhà phát triển nhằm cải thiện sản phẩm. Dữ liệu này bao gồm:

- Sự kiện khởi động (Startup events).

- Thời điểm và tên model được tải về (Pull events).

- Đôi khi bao gồm thông số phần cứng (GPU ID, VRAM capacity).

Trong môi trường doanh nghiệp (Enterprise), việc một thiết bị nội bộ liên tục gửi tín hiệu ra ngoài (Outbound Traffic) là một hành vi bất thường. Kẻ tấn công hoặc đối thủ cạnh tranh có thể dựa vào tần suất này để phán đoán quy mô hạ tầng và công nghệ mà công ty bạn đang áp dụng.

Rủi ro gãy quy trình RAG (Web Search)

Đây là vấn đề phổ biến nhất mà người dùng gặp phải khi xây dựng AI Agent. Khi bạn kích hoạt tính năng RAG (Retrieval-Augmented Generation) để AI tự động tìm kiếm thông tin trên Google/Bing:

- AI Agent sẽ gửi hàng loạt HTTP Request với tốc độ cực nhanh (nhanh hơn người thường bấm chuột hàng chục lần).

- Các công cụ tìm kiếm sở hữu hệ thống WAF (Web Application Firewall) sẽ nhận diện đây là hành vi của Bot.

- Hậu quả: IP của bạn bị đưa vào danh sách đen (IP Ban) hoặc liên tục bị yêu cầu giải Captcha. Điều này không chỉ làm gián đoạn AI mà còn có thể gây tê liệt khả năng truy cập Internet của toàn bộ nhân sự đang dùng chung đường truyền đó.

Vấn đề Geo-blocking và băng thông

Tại Việt Nam, việc truy cập vào các kho dữ liệu lớn như Hugging Face đôi khi gặp tình trạng chập chờn do sự cố cáp quang biển hoặc chính sách định tuyến của ISP. Việc tải một file model 50GB bị ngắt kết nối giữa chừng (Connection Reset) mà không có cơ chế Resume ổn định qua Proxy sẽ gây lãng phí thời gian và băng thông rất lớn.

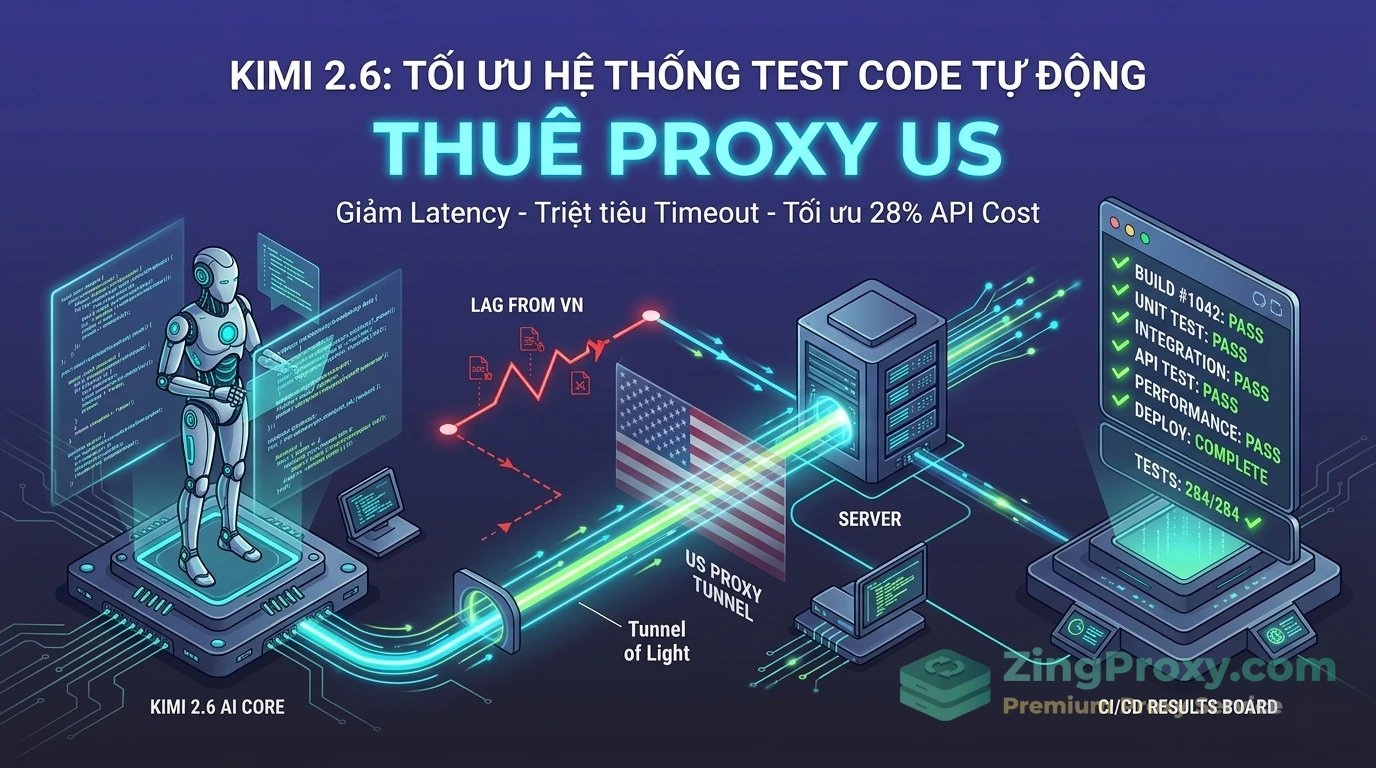

Chiến lược Hybrid Proxy: Tối ưu hiệu năng và chi phí

Không có một loại Proxy nào là “chìa khóa vạn năng”. Các kỹ sư hệ thống giàu kinh nghiệm luôn áp dụng chiến lược Hybrid Proxy (Proxy Lai) để cân bằng giữa tốc độ tải và khả năng ẩn mình.

Chúng ta sẽ sử dụng hai loại Proxy khác nhau cho hai mục đích riêng biệt:

A. Datacenter Proxy (IP Tĩnh) – Dành cho Inference Engine

Dùng cho Ollama / vLLM khi tải Model.

- Đặc điểm: Đây là IP được cấp phát từ các trung tâm dữ liệu (Cloud Server).

- Ưu điểm: Băng thông cực lớn (Gigabit speed), độ trễ thấp, giá thành rẻ.

- Lý do chọn: Khi tải file nặng vài chục GB, bạn cần một kết nối ổn định và nhanh nhất có thể. IP Tĩnh giúp đảm bảo phiên tải không bị ngắt quãng do thay đổi IP. Các kho như Hugging Face thường không chặn Datacenter IP quá gắt gao. Bạn có thể tìm hiểu kỹ hơn về sự khác biệt giữa ISP Proxy và Datacenter Proxy để chọn loại phù hợp nhất cho việc tải model.

B. Residential Proxy (Dân cư Xoay vòng) – Dành cho Web Search

Dùng cho OpenWebUI / LangChain / AI Agents.

- Đặc điểm: Đây là IP từ các thiết bị người dùng thật (Wifi hộ gia đình, 4G di động).

- Ưu điểm: Có Trust Score (Điểm tín nhiệm) rất cao trong mắt Google, Bing, Amazon.

- Lý do chọn: Khi AI thực hiện cào dữ liệu, nó cần “trông giống” một người dùng bình thường đang lướt web. Residential Proxy giúp vượt qua các lớp bảo mật chống Bot, Captcha, và Cloudflare WAF một cách mượt mà. Nếu dùng Datacenter IP cho việc này, tỷ lệ bị chặn là trên 90%. Đây chính là lý do tại sao bạn cần hiểu rõ Proxy dân cư là gì và ứng dụng của nó trong việc vượt qua các lớp bảo mật chống Bot.

Hướng dẫn cấu hình Proxy chuẩn (Technical Guide)

Cấu hình sai biến môi trường là nguyên nhân số 1 khiến Local LLM không thể hoạt động (lỗi phổ biến: Connection Refused hoặc Invalid Response). Dưới đây là quy trình thiết lập chuẩn DevOps cho các môi trường phổ biến.

Nguyên tắc sống còn: NO_PROXY và HTTPS_PROXY

- Chỉ dùng

HTTPS_PROXY: Ollama và các Registry hiện đại đều dùng HTTPS. Việc thiết lập thêm HTTP_PROXY thường gây ra lỗi giao tiếp nội bộ không cần thiết.

- Bắt buộc

NO_PROXY: Bạn phải khai báo biến này cho localhost. Nếu thiếu, Client App sẽ cố gắng đi vòng qua Internet (qua Proxy) để gọi ngược lại Ollama đang chạy ngay trên máy, tạo thành một vòng lặp chết (Loopback) và gây lỗi kết nối.

Kịch bản 1: Cấu hình trên macOS (Sử dụng Terminal)

Trên macOS, các ứng dụng chạy nền (như Ollama) không nhận biến môi trường từ file .zshrc hay giao diện Settings. Bạn bắt buộc phải sử dụng công cụ launchctl của hệ thống.

Bước 1: Dừng ứng dụng

Đảm bảo biểu tượng Ollama trên thanh Menu Bar đã được tắt hoàn toàn (Quit).

Bước 2: Thiết lập biến môi trường qua Terminal

Mở Terminal và nhập lần lượt các lệnh sau (thay thế thông tin proxy của bạn):

launchctl setenv HTTPS_PROXY "http://user:pass@proxy-ip:port"

launchctl setenv NO_PROXY "localhost,127.0.0.1"

Bước 3: Khởi động lại ứng dụng

Mở lại Ollama từ thư mục Applications. Lúc này, tiến trình nền đã nhận diện được Proxy.

Lưu ý kỹ thuật: Lệnh launchctl setenv chỉ có tác dụng trong phiên làm việc hiện tại (cho đến khi bạn Restart máy hoặc Logout). Để cấu hình bền vững (Persistent), bạn cần tạo một file .plist trong thư mục ~/Library/LaunchAgents để tự động nạp lệnh này mỗi khi đăng nhập.

Kịch bản 2: Cấu hình trên Linux (Systemd Service)

Trong môi trường Server Production, chúng ta không chạy thủ công mà chạy qua systemd. Việc dùng lệnh export trong shell là vô nghĩa với service nền.

Bước 1: Mở trình chỉnh sửa cấu hình override

sudo systemctl edit ollama.service

Bước 2: Thêm block cấu hình

Trình soạn thảo sẽ mở ra, bạn thêm đoạn sau vào giữa các dòng comment:

[Service]

Environment="HTTPS_PROXY=http://user:pass@proxy-ip:port"

Environment="NO_PROXY=localhost,127.0.0.1,0.0.0.0"

Bước 3: Áp dụng và khởi động lại

sudo systemctl daemon-reload

sudo systemctl restart ollama

Kịch bản 3: Cấu hình cho Docker (OpenWebUI)

Nếu bạn chạy Client App qua Docker, hãy truyền biến môi trường qua cờ -e:

docker run -d -p 3000:8080 \

-e HTTPS_PROXY="http://user:pass@residential-proxy:port" \

-e NO_PROXY="localhost,127.0.0.1,ollama" \

--name open-webui ghcr.io/open-webui/open-webui:main

Lưu ý: Nếu OpenWebUI và Ollama cùng nằm trong mạng Docker, hãy thêm tên container (ví dụ: ollama) vào NO_PROXY.

Tối ưu quyền riêng tư: Tắt Telemetry đúng cách

Bên cạnh việc ẩn danh đường truyền bằng Proxy, bước tiếp theo của bảo mật AI Local là ngăn chặn ứng dụng gửi dữ liệu thống kê.

Nhiều tài liệu cũ hoặc không chính thống thường nhắc đến các biến như OLLAMA_TELEMETRY hay OLLAMA_NOPRUNE. Đây là thông tin không chính xác hoặc đã lỗi thời.

OLLAMA_NOPRUNE / OLLAMA_KEEP_ALIVE: Dùng để quản lý RAM (thời gian giữ model trong bộ nhớ), không liên quan đến bảo mật.OLLAMA_TELEMETRY: Biến này không tồn tại trong mã nguồn hiện tại của Ollama.

Biến chính xác duy nhất để chặn Telemetry là: OLLAMA_NO_USAGE_STATS=1

Khi thêm biến này vào cấu hình (tương tự như cách thêm Proxy ở phần 4), Ollama sẽ hoạt động ở chế độ “Silent Mode”, hoàn toàn không gửi bất kỳ tín hiệu ping nào về máy chủ nhà phát triển. Đây là tiêu chuẩn vàng cho các hệ thống yêu cầu bảo mật dữ liệu tuyệt đối.

Troubleshooting: Khắc phục các lỗi phổ biến

Trong quá trình triển khai Proxy cho Local LLM, đây là 3 lỗi kỹ thuật kinh điển mà 90% kỹ sư hệ thống thường gặp phải.

Lỗi 1: connection refused khi gọi API Local

- Triệu chứng: Client App (OpenWebUI) báo lỗi

dial tcp 127.0.0.1:11434: connect: connection refused hoặc context deadline exceeded.

- Nguyên nhân: Bạn đã cấu hình

HTTPS_PROXY nhưng quên khai báo NO_PROXY. Hệ thống cố gắng đi vòng qua Proxy Server ở nước ngoài chỉ để kết nối với Ollama đang chạy ngay trên máy local.

- Khắc phục: Kiểm tra lại biến môi trường. Bắt buộc phải có dòng:

NO_PROXY=localhost,127.0.0.1,0.0.0.0

Lỗi 2: x509: certificate signed by unknown authority

- Triệu chứng: Không thể tải model từ Hugging Face hoặc Ollama Registry.

- Nguyên nhân: Proxy Server của bạn sử dụng cơ chế “SSL Inspection” (thường gặp ở tường lửa doanh nghiệp) hoặc bạn đang dùng Proxy tự dựng với chứng chỉ tự ký (Self-signed) mà máy chủ chưa tin cậy.

- Khắc phục:

- Tạm thời thêm biến

OLLAMA_INSECURE=1 (Không khuyến khích cho Production).

- Giải pháp chuẩn: Import Root CA của Proxy vào Trust Store của hệ điều hành (Linux/macOS).

Lỗi 3: Tốc độ Web Search (RAG) quá chậm hoặc Timeout

- Triệu chứng: Khi hỏi các câu cần tìm kiếm tin tức, AI mất hơn 30 giây để phản hồi hoặc báo lỗi timeout.

- Nguyên nhân: Bạn đang sử dụng Residential Proxy chất lượng thấp hoặc chọn Location (vị trí IP) quá xa so với Server đích.

- Khắc phục:

- Chuyển sang nhà cung cấp Proxy dân cư có tốc độ phản hồi < 1s.

- Cấu hình Timeout trong Client App lên mức cao hơn (ví dụ: 60s) để phù hợp với độ trễ của mạng dân cư.

Câu hỏi thường gặp (FAQ)

1. Tôi có thể dùng VPN thay cho Proxy được không?

Về lý thuyết là được, nhưng không tối ưu cho Server/Docker. VPN thường mã hóa toàn bộ lưu lượng của máy (System-wide), làm giảm hiệu năng của các tác vụ nội bộ khác. Proxy cho phép bạn chỉ định tuyến traffic của riêng ứng dụng AI (App-level Routing), giúp quản lý băng thông và định danh chính xác hơn. Bạn có thể xem thêm so sánh chi tiết tại bài viết Proxy và VPN: Tại sao nên sử dụng kết hợp?.

2, DeepSeek-R1 bản Distill có thông minh bằng bản gốc không?

Các bản Distill (7B/8B/70B) được học lại từ tư duy của bản gốc 671B. Tuy không thể đạt 100% sức mạnh như bản gốc, nhưng hiệu năng/chi phí của chúng là vô địch cho nhu cầu Local. Với các tác vụ lập trình (Coding) hay suy luận logic thông thường, bản Distill 32B/70B hoàn toàn đủ sức thay thế GPT-4o.

3. Tôi có nên dùng Proxy miễn phí để tiết kiệm chi phí không?

Tuyệt đối không. Free Proxy thường ghi lại (Log) toàn bộ nội dung gói tin. Việc bạn gửi Prompt chứa dữ liệu nhạy cảm qua Free Proxy tương đương với việc công khai dữ liệu đó cho hacker. Hãy coi chi phí Proxy là phí bảo hiểm bắt buộc cho dữ liệu doanh nghiệp.

4. Biến OLLAMA_KEEP_ALIVE có ảnh hưởng đến bảo mật không?

Không. Biến này chỉ quy định thời gian giữ Model trong RAM/VRAM để chat nhanh hơn ở lần sau. Nó không liên quan đến việc gửi dữ liệu ra ngoài. Để bảo mật, hãy tập trung vào OLLAMA_NO_USAGE_STATS.

Kết luận

Việc chuyển dịch về Local AI với các mô hình như DeepSeek hay Llama 3 là bước đi chiến lược để làm chủ dữ liệu và công nghệ. Tuy nhiên, một hệ thống mạnh mẽ cần một hạ tầng mạng thông minh và an toàn.

Đừng để hạ tầng mạng trở thành “gót chân Achilles” của hệ thống AI. Bằng việc:

- Phân tách kiến trúc: Proxy riêng cho Inference Engine và Client App.

- Chiến lược Hybrid: Datacenter Proxy cho tải trọng lớn, Residential Proxy cho Web Search.

- Cấu hình chính xác: Sử dụng

launchctl (Mac) hoặc systemd (Linux) và tuân thủ nguyên tắc NO_PROXY.

Bạn sẽ xây dựng được một pháo đài AI vững chắc: Ổn định trong vận hành, tối ưu về chi phí và ẩn mình hoàn hảo trước các rủi ro định danh trên không gian mạng.

Bạn muốn tư vấn sâu hơn về việc chọn nhà cung cấp Residential Proxy phù hợp cho AI Agent? Hãy để lại câu hỏi bên dưới để được hỗ trợ chi tiết.

Tài liệu tham khảo