Trong bối cảnh năm 2026, khi các mô hình AI mã nguồn mở (Open Weights) như Llama 3.3 hay DeepSeek-R1 đã đạt sức mạnh ngang ngửa với các siêu AI đóng kín, một làn sóng chuyển dịch công nghệ mang tên Repatriation (Đưa dữ liệu về hạ tầng riêng) đang diễn ra mạnh mẽ. Các doanh nghiệp không còn muốn trả những hóa đơn API đắt đỏ hàng tháng hay mạo hiểm gửi dữ liệu nhạy cảm lên đám mây công cộng.

Nhu cầu sở hữu một hệ thống Private AI (AI riêng tư) là rất lớn, nhưng rào cản lớn nhất khiến các CTO và Developer chùn bước chính là chi phí phần cứng. Một câu hỏi kinh điển được đặt ra: Làm sao để chạy một mô hình 70 tỷ tham số (70B) mượt mà như ChatGPT mà không cần đầu tư hàng chục nghìn USD cho cụm GPU NVIDIA A100/H100?

Câu trả lời nằm ở việc thuê VPS chạy AI (bạn có thể xem thêm cách chọn mua VPS tối ưu tại đây) với chiến lược tối ưu hóa chính xác đến từng Gigabyte bộ nhớ. Bài viết này sẽ cung cấp bản thiết kế hệ thống Private Cloud hiệu năng cao với chi phí tối thiểu, giúp bạn giải quyết bài toán kinh tế hạ tầng một cách triệt để.

Tóm tắt bài viết:

- VRAM là yếu tố quan trọng nhất: Cần 48GB cho model 70B.

- Dùng vLLM cho môi trường doanh nghiệp để tăng tốc độ gấp 24 lần.

- Chiến lược Hybrid: Tách riêng Server Chat và Server GPU để giảm 70% chi phí.

Chiến lược phần cứng: VRAM là vua (Sự thật kỹ thuật)

Khi thuê VPS chạy AI, đừng để bị lóa mắt bởi số lượng nhân CPU hay dung lượng ổ cứng SSD. Yếu tố sống còn quyết định mô hình AI có chạy được hay không là VRAM (Video RAM) của GPU.

Khác với các ứng dụng web truyền thống, AI Inference (chạy suy luận) yêu cầu nạp toàn bộ trọng số mô hình (Model Weights) và bộ nhớ đệm ngữ cảnh (KV Cache) vào VRAM. Nếu VRAM bị tràn, hệ thống buộc phải sử dụng RAM hệ thống (thông qua giao tiếp PCIe), khiến tốc độ xử lý giảm từ 50-100 lần, biến trải nghiệm mượt mà thành tình trạng giật lag nghiêm trọng.

Giải mã lầm tưởng: Một card 24GB cân tất cả

Rất nhiều hướng dẫn cũ (giai đoạn 2023-2024) cho rằng một card đồ họa Consumer cao cấp như RTX 3090 hay RTX 4090 (24GB VRAM) là đủ dùng. Tuy nhiên, với các chuẩn mực mô hình của năm 2026, con số này là KHÔNG ĐỦ.

Hãy nhìn vào số liệu thực tế đã được kiểm chứng từ kho lưu trữ model:

- Llama 3.3 70B (Bản chuẩn hiện nay): Ngay cả khi sử dụng kỹ thuật lượng tử hóa 4-bit (định dạng GGUF chuẩn

Q4_K_M), kích thước tệp model vẫn nặng chính xác 42.5 GB.

- Bộ nhớ ngữ cảnh (KV Cache): Để duy trì một cuộc hội thoại dài khoảng 8192 tokens, bạn cần thêm khoảng 2-4GB VRAM.

Kết luận kỹ thuật: Tổng dung lượng VRAM cần thiết để chạy Llama 3.3 70B là khoảng 46-48GB. Do đó, một VPS chỉ gắn 1x RTX 3090 (24GB) sẽ báo lỗi OOM (Out Of Memory) ngay lập tức khi load model.

Sự thật về DeepSeek-V3 (671B MoE)

DeepSeek-V3 là một mô hình kiến trúc Mixture-of-Experts (MoE) khổng lồ với tổng tham số lên tới 671 tỷ (671B). Mặc dù trong mỗi lần sinh từ, nó chỉ kích hoạt 37B tham số, nhưng để vận hành, hệ thống bắt buộc phải nạp toàn bộ 671B tham số vào bộ nhớ.

- Yêu cầu phần cứng: Cần khoảng 350GB – 400GB VRAM (tương đương cụm 8x A100 80GB) để chạy bản nén 4-bit.

- Lời khuyên: Đừng cố thuê VPS đơn lẻ để chạy DeepSeek-V3 bản gốc. Thay vào đó, hãy sử dụng các phiên bản DeepSeek-R1-Distill (được chưng cất sang kiến trúc Llama hoặc Qwen) với kích thước 8B, 14B, 32B hoặc 70B để phù hợp với ngân sách.

Bảng cấu hình VPS chạy AI khuyến nghị (Tối ưu price/performance)

Dựa trên phân tích kỹ thuật ở trên, dưới đây là 3 kịch bản cấu hình VPS chạy AI tối ưu nhất cho năm 2026, giúp bạn tránh lãng phí tài nguyên.

Kịch bản A: Entry level (Cơ bản) – Ngân sách < $150/tháng

Dành cho cá nhân, Developer phát triển ứng dụng Chatbot nội bộ, trợ lý Code (Coding Assistant).

- Model mục tiêu:

- DeepSeek-R1-Distill-Llama-8B: Tốc độ cao, thông minh cho các tác vụ logic.

- Llama-4-Scout-17B: Dòng model đa phương thức (Multimodal) mới của Meta, hỗ trợ xử lý hình ảnh sang văn bản (Image-to-Text).

- Cấu hình VPS:

- GPU: 1x NVIDIA RTX 3090 hoặc RTX 4090 (24GB VRAM).

- CPU: 8 vCPU.

- RAM: 32GB.

- Đánh giá: 24GB VRAM là dư dả để chạy các model < 20B tham số ở mức lượng tử hóa cao (Q6/Q8), hoặc chạy model 32B ở mức nén sâu (Q4).

Sau khi thuê VPS, việc đầu tiên bạn cần làm là thiết lập môi trường. Hãy tham khảo hướng dẫn cài đặt VPS Ubuntu chuẩn bảo mật trước khi cài đặt Docker và Driver NVIDIA.

Kịch bản B: Mid-range (Tiêu chuẩn) – Ngân sách $300 – $500/tháng

Dành cho doanh nghiệp SME cần triển khai Private AI chất lượng cao (tương đương GPT-4) phục vụ nội bộ.

- Model mục tiêu:

- Llama 3.3 70B (Quantized 4-bit): Model văn bản mạnh nhất trong phân khúc mã nguồn mở.

- DeepSeek-R1-Distill-70B: Tối ưu cho các tác vụ suy luận phức tạp (Reasoning).

- Cấu hình VPS:

- GPU: 2x NVIDIA RTX 3090 (Tổng 48GB VRAM).

- Kết nối: Ưu tiên VPS có cầu nối NVLink để tăng tốc độ giao tiếp giữa 2 GPU (giúp tăng tốc độ sinh từ token/s).

- Đánh giá: Đây là cấu hình điểm cân bằng (Sweet Spot) về kinh tế. Với 48GB VRAM, bạn vừa đủ để chứa trọn vẹn model 70B (42.5GB) và còn dư khoảng 5GB cho Context Window, đảm bảo tốc độ phản hồi nhanh.

Kịch bản C: Enterprise (Cao cấp) – Ổn định & chịu tải

Dành cho môi trường Production yêu cầu chạy 24/7, phục vụ nhiều người dùng đồng thời (High Concurrency).

- Cấu hình VPS:

- GPU: 1x NVIDIA RTX 6000 Ada hoặc A6000 (48GB VRAM).

- Tại sao không dùng 2x 3090? Dòng GPU Consumer (GeForce) không có bộ nhớ sửa lỗi (ECC Memory) và độ ổn định không cao khi chạy liên tục nhiều tháng. Dòng A6000/6000 Ada là chuẩn Workstation/Server, đảm bảo độ tin cậy tuyệt đối và khả năng quản lý nhiệt tốt hơn.

Bảng so sánh hiệu năng & giá thành các dòng GPU (Benchmark 2026)

Để giúp bạn dễ dàng hình dung sự chênh lệch giữa các dòng card, dưới đây là bảng so sánh khả năng chạy các model phổ biến (Llama 3.3, DeepSeek-R1 Distill) dựa trên VRAM và Băng thông bộ nhớ (Memory Bandwidth).

| Loại GPU |

VRAM |

Băng thông (GB/s) |

Khả năng chạy Model (4-bit Quantized) |

Giá thuê (Spot/Giờ) |

Đánh giá (Verdict) |

| NVIDIA RTX 3060 |

12 GB |

360 |

Tốt: Llama-3.1-8B, Gemma-7B.

Không thể: Model > 14B. |

~$0.1 – $0.15 |

Giá rẻ nhất. Phù hợp nghiên cứu, học tập, Chatbot cá nhân. |

| NVIDIA RTX A4000 |

16 GB |

448 |

Tốt: DeepSeek-Distill-14B, Llama-4-Scout (Image).

Khá: Model 14B với context dài. |

~$0.2 – $0.25 |

Lựa chọn tốt tầm thấp. Ổn định hơn dòng GeForce, VRAM đủ dùng cho đa số tác vụ nhẹ. |

| NVIDIA RTX 3090 / 4090 |

24 GB |

936 / 1,008 |

Mượt: DeepSeek-Distill-32B.

Cố gắng: Llama-70B (chỉ khi dùng kỹ thuật offload CPU rất chậm). |

~$0.3 – $0.45 |

Hiệu năng/Giá tốt nhất. Băng thông cực lớn giúp tốc độ token/s rất nhanh. |

| 2x RTX 3090 (NVLink) |

48 GB |

936 x2 |

Mượt: Llama-3.3-70B, Qwen-72B.

Tốt: DeepSeek-Distill-70B. |

~$0.6 – $0.8 |

Điểm tối ưu (Sweet Spot). Cấu hình rẻ nhất để chạy mượt model 70B chuẩn doanh nghiệp. |

| NVIDIA A100 (80GB) |

80 GB |

1,935 |

Mượt: Chạy được model 70B full context hoặc nhiều model nhỏ cùng lúc. |

~$2.0 – $4.0 |

Chi phí cao cho Inference. Chỉ nên dùng nếu cần Training hoặc chạy DeepSeek-V3 bản gốc (cần cụm 8 card). |

Lưu ý: Giá thuê (Spot Price) có thể biến động tùy vào cung cầu trên các sàn như Vast.ai hay RunPod. Giá thuê VPS cố định (Fixed) tại Việt Nam thường tính theo tháng và cao hơn nhưng đảm bảo tính ổn định và bảo mật dữ liệu.

Chiến lược phần mềm: Cuộc chiến của các runtime

Phần cứng mạnh đến đâu mà phần mềm không tối ưu cũng vô nghĩa. Để khai thác triệt để sức mạnh của VPS chạy AI, bạn cần bộ công cụ phần mềm (Software Stack) hiện đại nhất.

Quantization (Lượng tử hóa): Chìa khóa tiết kiệm

Chạy model ở độ chính xác 16-bit (FP16) là sự lãng phí tài nguyên lớn cho nhu cầu suy luận. Hãy luôn tìm kiếm các bản nén chuẩn GGUF (cho Ollama) hoặc AWQ (cho vLLM).

- Hiệu quả: Llama 3.3 70B giảm từ ~140GB xuống còn ~42.5GB VRAM.

- Chất lượng: Các nghiên cứu chỉ ra rằng bản 4-bit (Q4_K_M) giữ được hơn 95% khả năng xử lý của bản gốc.

Ollama vs. vLLM: Lựa chọn công cụ nào?

Đây là hai cái tên phổ biến nhất hiện nay, nhưng chúng phục vụ mục đích khác nhau:

- Ollama: Lựa chọn hàng đầu cho Developer & Home Lab.

- Ưu điểm: Dễ cài đặt, quản lý model đơn giản qua dòng lệnh, hỗ trợ tốt file GGUF.

- Nhược điểm: Khả năng xử lý song song kém. Nếu có 5-10 người cùng chat một lúc, Ollama dễ bị nghẽn hoặc lỗi do quản lý bộ nhớ chưa tối ưu cho tải cao.

- vLLM: Lựa chọn bắt buộc cho Production/Doanh nghiệp.

- Công nghệ lõi: Sử dụng PagedAttention (một kỹ thuật lấy cảm hứng từ bộ nhớ ảo của hệ điều hành). Nó chia nhỏ bộ nhớ KV Cache thành các block không liên tục, giúp loại bỏ hoàn toàn sự lãng phí bộ nhớ do phân mảnh.

- Hiệu năng: vLLM có thể tăng thông lượng (throughput) lên gấp 24 lần so với các thư viện cũ (như HuggingFace Transformers) khi chịu tải cao. Đây là công cụ giúp bạn phục vụ hàng chục nhân viên chỉ trên một VPS.

Open WebUI: Hơn cả một giao diện chat

Đừng để nhân viên của bạn phải dùng dòng lệnh. Hãy triển khai Open WebUI (trước đây là Ollama WebUI). Đây là một Client Application hoàn chỉnh với các tính năng doanh nghiệp:

- RAG (Retrieval Augmented Generation): Nhân viên có thể upload file PDF, Word quy trình nội bộ vào khung chat. Open WebUI tự động vector hóa và cho phép AI trả lời dựa trên tài liệu đó.

- Web Search: Tích hợp với công cụ tìm kiếm (như SearXNG) để AI có thể truy cập internet lấy thông tin thời gian thực.

- RBAC: Quản lý quyền truy cập (Admin/User), phê duyệt tài khoản mới, đảm bảo an ninh nội bộ.

Xử lý các vấn đề kỹ thuật (Troubleshooting)

Khi triển khai thực tế, bạn sẽ gặp những lỗi mà ít tài liệu nào đề cập. Dưới đây là cách xử lý 2 vấn đề phổ biến nhất.

Vấn đề proxy doanh nghiệp (Corporate proxy)

Nhiều doanh nghiệp đặt VPS sau hệ thống Proxy bảo mật nghiêm ngặt. Khi cài đặt Ollama, bạn thường gặp lỗi không thể tải model (ollama pull thất bại, lỗi invalid character '<').

Nguyên nhân: Xung đột biến môi trường. Ollama Client (localhost) cố gắng đi qua Proxy để kết nối với Ollama Server (localhost).

Giải pháp (Fix): Cấu hình file service của Ollama (sử dụng lệnh systemctl edit ollama.service) với nội dung như sau:

[Service]

# Thiết lập Proxy để tải model từ Internet

Environment="HTTPS_PROXY=http://proxy.company.com:8080"

# QUAN TRỌNG: Bỏ qua Proxy cho các kết nối nội bộ

Environment="NO_PROXY=localhost,127.0.0.1,0.0.0.0"

Lưu ý: Tuyệt đối KHÔNG set biến HTTP_PROXY cho service Ollama để tránh lỗi vòng lặp kết nối. Để biết chi tiết từng bước thực hiện lệnh, mời bạn xem bài viết chuyên sâu: Hướng dẫn cấu hình Proxy cho Ollama và DeepSeek vượt tường lửa.

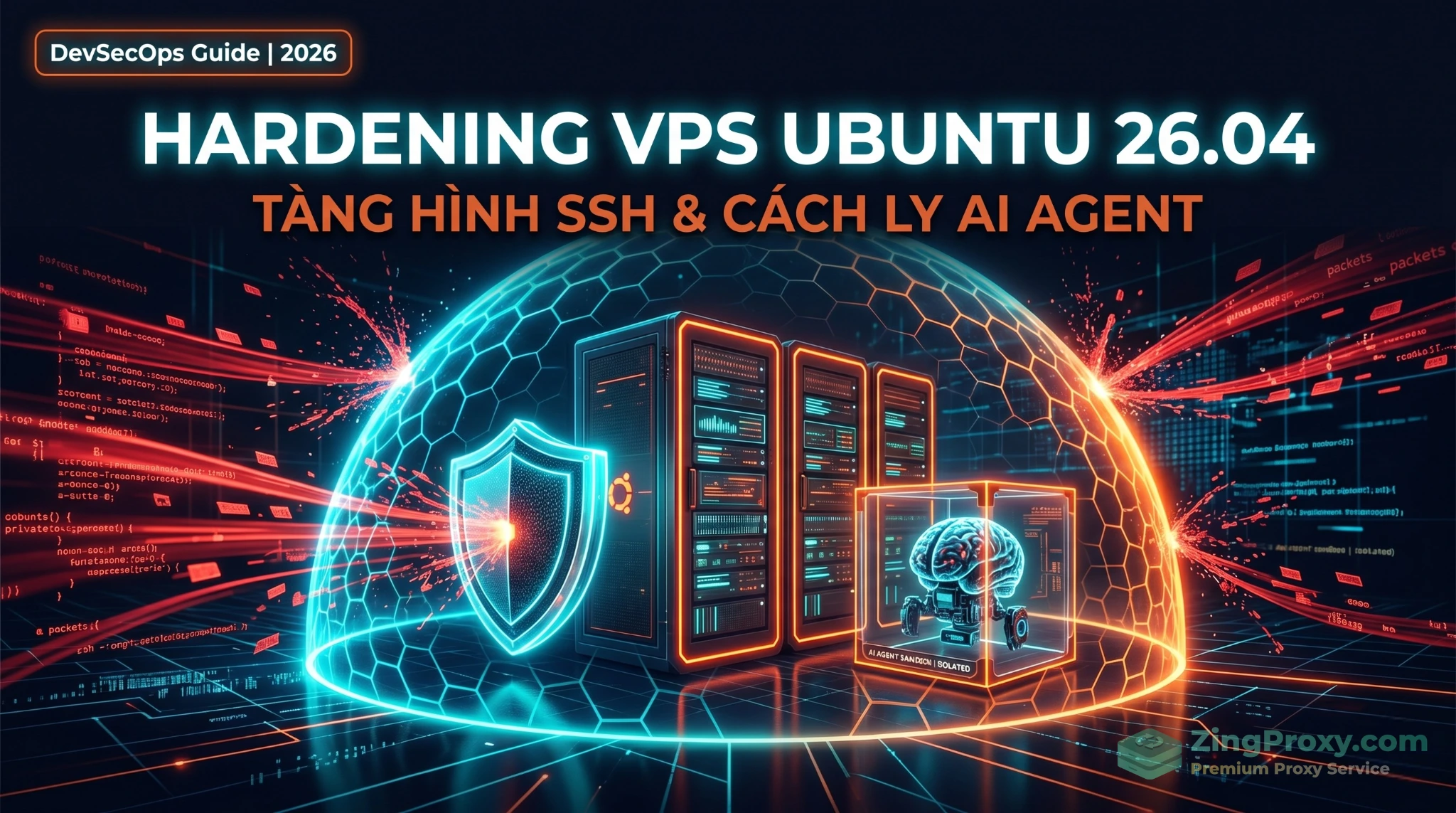

Bảo mật & riêng tư (Zero trust)

Tự host (Self-hosted) không có nghĩa là mặc định an toàn. Các nhị phân (binary) của phần mềm AI vẫn có thể gửi dữ liệu viễn trắc (telemetry) về máy chủ hãng.

Cách Hardening (Gia cố bảo mật):

- Tắt Telemetry: Thiết lập biến môi trường sau để chặn Ollama gửi báo cáo sử dụng:

OLLAMA_NO_USAGE_STATS=1

- Định dạng Model: Chỉ sử dụng model định dạng

.safetensors hoặc .gguf. Tránh xa các model cũ dùng định dạng .pickle hoặc .bin không rõ nguồn gốc vì chúng có thể chứa mã độc thực thi (Remote Code Execution).

- Firewall: Cấu hình tường lửa chặn toàn bộ kết nối đi ra (Outbound Traffic) từ container chạy AI, chỉ mở whitelist cho các domain cần thiết (như HuggingFace khi cần update model).

Bài toán kinh tế: Chọn nhà cung cấp VPS nào?

Để tối ưu chi phí (OpEx) cho VPS chạy AI, bạn cần chọn mô hình thuê phù hợp với quy trình làm việc (Workflow) của mình.

GPU spot instances (Thuê theo giờ)

- Cơ chế: Thuê các GPU “nhàn rỗi” từ khắp nơi trên thế giới.

- Giá thành: Rất thấp (chỉ khoảng $0.2 – $0.4/giờ cho 1x RTX 3090).

- Nhược điểm: Dữ liệu không bền vững (Instance có thể bị tắt bất cứ lúc nào nếu chủ sở hữu đòi lại máy).

- Phù hợp: Đội ngũ R&D cần môi trường để Test model mới, chạy các tác vụ Batch processing ngắn hạn.

Hybrid architecture (Kiến trúc lai – Tiết kiệm nhất)

Đây là chiến lược thông minh nhất để giảm chi phí cho doanh nghiệp:

- Frontend Server: Thuê một VPS CPU chi phí thấp (khoảng 150k/tháng) chạy Open WebUI. Server này bật 24/7 để nhân viên truy cập, xem lịch sử chat.

- Backend Server: Thuê VPS GPU (Spot Instance hoặc Pay-as-you-go). Sử dụng API để kết nối với Frontend. Server này chỉ bật trong giờ hành chính hoặc khi có nhu cầu xử lý nặng.

- Hiệu quả: Giảm tới 70-80% chi phí so với việc thuê một GPU Server cố định chạy 24/7 mà buổi đêm không ai dùng.

VPS GPU Việt Nam (Production ổn định)

- Nhà cung cấp: Các đơn vị trong nước.

- Lợi thế: Độ trễ thấp (Low Latency) giúp Chatbot phản hồi tức thì. IP an toàn, tin cậy (Clean IP), băng thông trong nước ổn định không lo đứt cáp quang biển. Hỗ trợ xuất hóa đơn VAT hợp lệ cho doanh nghiệp.

- Phù hợp: Chạy hệ thống Production, Chatbot CSKH, các ứng dụng yêu cầu sự ổn định lâu dài.

Nếu bạn muốn xây dựng hệ thống tự động hóa sâu hơn thay vì chỉ chat, hãy tham khảo bài viết Tích hợp DeepSeek API trên VPS cho doanh nghiệp để mở rộng khả năng của hệ thống.

Câu hỏi thường gặp (FAQ)

1. Tôi có thể dùng VPS CPU (không có GPU) để chạy DeepSeek không?

Được, nhưng hiệu năng thấp. Bạn có thể dùng thư viện llama.cpp để chạy DeepSeek-R1-Distill (bản 7B/8B) trên VPS CPU có nhiều RAM (16GB+). Tuy nhiên, tốc độ trả lời sẽ chỉ khoảng 2-4 từ/giây (tokens/s), chỉ phù hợp cho các tác vụ chạy ngầm như tóm tắt văn bản, phân loại email, không phù hợp để chat trực tiếp.

2. Tại sao tôi cài Ollama xong nhưng không thể tải (pull) model về?

Lỗi này 90% là do cấu hình Proxy không đúng hoặc xung đột biến môi trường. Nếu VPS của bạn nằm sau tường lửa công ty, hãy đảm bảo bạn đã cấu hình HTTPS_PROXY và quan trọng nhất là NO_PROXY=localhost để tránh việc Ollama tự chặn kết nối của chính nó.

3. Dữ liệu của tôi có an toàn khi thuê GPU giá rẻ (Spot Instance) không?

Không hoàn toàn. Các máy chủ Spot (như trên Vast.ai) là máy của người khác cho thuê lại. Dù có cơ chế mã hóa container, nhưng về lý thuyết chủ máy vẫn có thể can thiệp vật lý.

- Lời khuyên: Chỉ dùng Spot Instance để Test hoặc chạy các dữ liệu không nhạy cảm. Với dữ liệu khách hàng hoặc bí mật kinh doanh, hãy thuê VPS tại các Datacenter uy tín (như tại Việt Nam) hoặc dùng server vật lý riêng.

4. RAM hệ thống (System RAM) bao nhiêu là đủ nếu đã có GPU VRAM lớn?

Một quy tắc nhỏ là RAM hệ thống nên gấp 1.5 đến 2 lần VRAM của GPU. Ví dụ: Nếu bạn dùng card 24GB VRAM, hãy thuê VPS có ít nhất 32GB – 48GB RAM hệ thống. Lý do là trước khi nạp vào GPU, model cần được load vào RAM thường, và hệ điều hành cũng cần RAM để quản lý các tiến trình (Docker, WebUI).

5. vLLM và Ollama, cái nào tốt hơn?

- Chọn Ollama: Nếu bạn là người mới, dùng cho cá nhân (1 người dùng), muốn cài đặt nhanh chóng.

- Chọn vLLM: Nếu bạn triển khai cho công ty (nhiều người dùng cùng lúc). vLLM có công nghệ PagedAttention giúp chịu tải gấp 10-20 lần Ollama mà không bị tràn bộ nhớ.

Kết luận

Việc xây dựng hệ thống Private AI trên VPS trong năm 2026 không còn là sân chơi chỉ dành cho các tập đoàn công nghệ lớn. Chìa khóa thành công không nằm ở việc mua phần cứng đắt tiền nhất, mà nằm ở sự hiểu biết sâu sắc về kỹ thuật:

- Hiểu đúng về VRAM: 48GB là con số vàng cho model 70B.

- Chọn đúng Runtime: vLLM cho Production, Ollama cho Dev.

- Tối ưu kiến trúc: Sử dụng mô hình Hybrid để linh hoạt dòng tiền.

Bằng cách áp dụng các chiến lược lượng tử hóa và lựa chọn cấu hình VPS thông minh như bài viết đã phân tích, doanh nghiệp của bạn hoàn toàn có thể sở hữu một trí tuệ nhân tạo riêng, bảo mật tuyệt đối với chi phí vận hành chỉ bằng một phần nhỏ so với việc sử dụng API công cộng.

Tài liệu tham khảo